São 442 os projetos que utilizam tecnologias de reconhecimento facial (TRF) na segurança pública no Brasil, de acordo com monitoramento feito pelo Panóptico, iniciativa do Centro de Estudos de Segurança e Cidadania (CESeC). O levantamento mostra que governos de todas as regiões já realizaram investimentos milionários na tecnologia, apesar das críticas de especialistas que apontam uma baixa taxa de acerto em relação ao custo e aos riscos envolvidos.

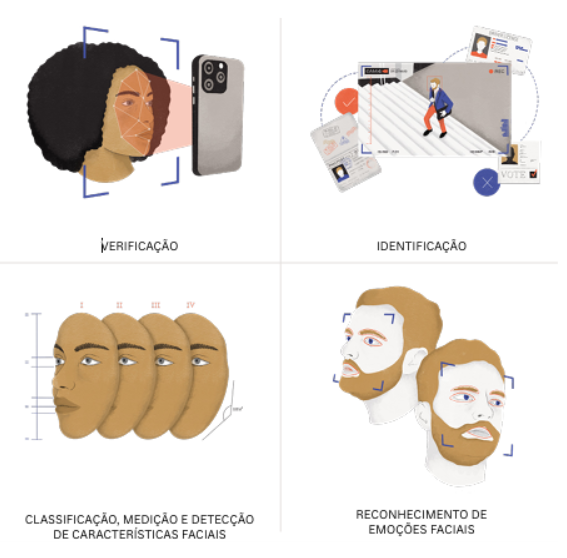

Na prática, o uso do reconhecimento facial na segurança pública ocorre por meio de câmeras equipadas com uma tecnologia capaz de identificar e comparar rostos captados em tempo real com imagens armazenadas em bancos de dados, geralmente compostos por registros civis ou policiais.

O objetivo frequentemente declarado das autoridades é localizar foragidos, prevenir crimes e ampliar o controle em grandes eventos. No entanto, falhas recorrentes, vieses raciais e a ausência de transparência sobre o funcionamento dos sistemas têm alimentado o debate sobre a real eficácia e legitimidade dessas ferramentas.

É nesse contexto que o Brasil recebe uma nova contribuição para a discussão: a tradução para o português do relatório “De Olho nos Vigilantes: Combatendo a Propagação do Reconhecimento Facial na Segurança Pública”, produzido pela International Network of Civil Liberties Organizations (INCLO).

A publicação, lançada na semana passada pela Conectas e pelo Instituto da Hora – responsáveis pela tradução -, traz princípios para reduzir os danos aos direitos humanos causados pela tecnologia e se soma ao trabalho já realizado por pesquisadores e jornalistas brasileiros, que vêm destacando os riscos e dilemas na fronteira entre inovação tecnológica, segurança pública e direitos fundamentais.

Para Nina da Hora, diretora executiva do Instituto da Hora, o relatório representa um avanço importante por romper com a tendência de centralizar o debate apenas em Estados Unidos e Europa. “Ao trazer experiências da Argentina, Colômbia, Palestina, África do Sul e outros países do Sul Global, o documento amplia o campo de comparação e fortalece alianças, mostrando que o Brasil não está isolado nessa discussão”, afirmou.

Já Carla Vreche, Assessora na Diretoria de Fortalecimento do Movimento de Direitos Humanos na Conectas, avalia que a publicação pode contribuir diretamente para o debate em torno do Projeto de Lei 2338/2023, aprovado no Senado em 2024 e atualmente em análise na Câmara dos Deputados, que busca estabelecer uma regulação da inteligência artificial no país.

“De modo bastante particular, o relatório discute padrões mínimos de governança para o uso desses sistemas. O texto do PL, embora reconheça que o reconhecimento facial deve ser considerado de ‘risco excessivo’ e, portanto, vedado, cria exceções que permitem sua aplicação em áreas como a segurança pública – sem ao menos prever qualquer mecanismo de governança”, criticou.

O ciclo de erros do reconhecimento facial

Em entrevistas concedidas à reportagem, Thalitta Lima, assistente de coordenação no Panóptico, Pedro Diogo Carvalho, coordenador do Grupo de Trabalho de Vigilância no Laboratório de Políticas Públicas e Internet (LAPIN) e a cientista da computação Nina da Hora, traçaram um panorama dos principais riscos associados ao uso do reconhecimento facial no Brasil. Elas destacam que a tecnologia opera dentro de um ciclo de erros que vai além de falhas técnicas, refletindo também problemas estruturais e operacionais.

Entre os pontos críticos, estão:

- Baixa precisão com grupos específicos: os algoritmos apresentam taxas de erro mais altas com pessoas negras, indígenas, asiáticas, mulheres e pessoas transexuais, reforçando desigualdades históricas da segurança pública.

- Infraestrutura precária: a má qualidade das câmeras, a iluminação inadequada e o posicionamento dos equipamentos comprometem ainda mais a precisão do sistema.

- Bases de dados desatualizadas: muitas vezes, os sistemas são alimentados por mandados de prisão vencidos, gerando prisões indevidas e constrangimento público.

- Risco de abordagens violentas: quando um alerta é emitido, a ação policial tende a ser imediata e muitas vezes violenta, aumentando o potencial de violações de direitos.

- Falsos positivos sistemáticos: experiências como a do Rio de Janeiro mostram índices alarmantes — em 11 detenções durante um período de teste, sete eram erros, ou seja, 63% de falsos positivos.

- Desigualdade social: pessoas em maior vulnerabilidade socioeconômica têm menos acesso a recursos jurídicos para contestar erros do sistema.

- Ameaça à democracia: especialistas também alertam para os riscos do uso do reconhecimento facial em protestos ou espaços públicos, que podem fragilizar o direito à reunião, à expressão e à organização política.

O relatório do INCLO oferece uma série de instrumentos para avaliar os impactos do uso policial de tecnologias de reconhecimento facial sobre os direitos humanos. Os questionamentos vão desde se o uso da TRF pela polícia está em conformidade com padrões internacionais de direitos humanos até se as pessoas monitoradas são devidamente informadas sobre a utilização da tecnologia. O documento não apenas formula essas perguntas, mas também orienta sobre como respondê-las. No Brasil, porém, nenhuma dessas questões foi considerada antes da implementação dos sistemas, e seguem sem resposta até hoje.

Segundo especialistas, esse ciclo de erros e a falta de transparência na resposta a perguntas fundamentais sobre a implementação dos sistemas criam um efeito perverso: em vez de corrigir falhas da segurança pública, o reconhecimento facial tende a reproduzir práticas discriminatórias e ampliar a vigilância sobre populações já marginalizadas.

Dinheiro público, lucro privado

Muito embora as tecnologias de reconhecimento facial sejam frequentemente apresentadas como símbolo de modernização da segurança pública, especialistas alertam, ainda, para os altos custos e a baixa efetividade desse investimento. Para Nina da Hora, o modelo atual gera três problemas centrais: “os recursos são desviados de prioridades sociais, os contratos carecem de transparência e, na prática, não há evidências de que a tecnologia reduza a criminalidade”.

Um levantamento do Panóptico, utilizado em reportagem do Intercept Brasil, ajuda a dimensionar esse desvio de prioridades. O estudo aponta que o montante gasto pelo governo da Bahia em equipamentos e softwares de reconhecimento facial seria suficiente para comprar 1,5 mil ambulâncias com UTI móvel, construir 300 UPAs ou manter em funcionamento um hospital de referência por 32 anos.

Apesar desse investimento, o Intercept analisou que em 2022 o estado da Bahia registrou quase 7 mil homicídios (dados do Fórum Brasileiro de Seg. Púb.), permanecendo entre os mais violentos do país, uma evidência de que a presença maciça das câmeras não se traduziu em maior segurança.

Quem lucra, em contrapartida, são as empresas de tecnologia e segurança. Segundo Thalitta Lima, “o Brasil se tornou um grande mercado de sistemas de reconhecimento facial”, em que companhias nacionais e internacionais disputam contratos milionários com governos estaduais, prefeituras e até estádios de futebol, após a aprovação da Lei Geral do Esporte.

Além do retorno financeiro, há também ganhos políticos. Projetos como o Smart Sampa, em São Paulo, são divulgados como símbolos de modernização da segurança pública, ainda que faltem evidências concretas de impacto positivo na redução da violência. “Trata-se de um mercado de vigilância que beneficia poucos e vulnerabiliza muitos”, resume Lima.

Leia também>> Regulação digital: o que pode avançar ainda este ano no Congresso

A urgência de uma regulação robusta

E enquanto tais tecnologias avançam rapidamente no Brasil, a regulação segue fragmentada e insuficiente. Hoje, projetos se multiplicam em diferentes municípios e estados, cada um com suas próprias regras ou, muitas vezes, sem nenhuma. O resultado, como observa Thallita Lima, é uma “expansão desregulada”, que dificulta tanto o rastreamento de iniciativas quanto a definição de padrões mínimos de governança.

Enquanto isso, outros países têm adotado uma postura mais cautelosa. Cidades como São Francisco e Oakland, nos Estados Unidos, baniram o uso do reconhecimento facial em espaços públicos, enquanto o Reino Unido criou autoridades específicas para fiscalizar a compatibilidade dessas tecnologias com os direitos fundamentais.

Já a União Europeia classificou os sistemas de reconhecimento facial como de “alto risco”, impondo restrições severas, como a necessidade de autorização prévia, limitação temporal e geográfica de uso e avaliação de impacto sobre os direitos fundamentais.

Até mesmo a ONU recomendou, em 2020, uma moratória para o uso em manifestações pacíficas, alertando para os riscos à liberdade de reunião e de expressão.

No Brasil, a Coalizão Direitos na Rede lançou em 2022 a campanha “Tire meu rosto da sua mira”, uma mobilização da sociedade civil que pede o banimento total do uso de tecnologias de reconhecimento facial na segurança pública. Segundo a carta-manifesto da campanha, a medida se justifica pelo entendimento de que os problemas dessas tecnologias são inseparáveis de seu próprio uso, sem soluções efetivas para eliminar vieses, erros ou riscos de violação de direitos.

O texto do PL 2338/2023, mencionado no início da matéria, apresenta lacunas que alertam especialistas sobre a urgência de colocar os direitos fundamentais no centro da regulação.

Além disso, há a questão da proteção de dados pessoais. A Lei Geral de Proteção de Dados (13.709/2018) classifica a biometria facial como dado sensível, exigindo bases legais mais rigorosas para seu tratamento. Na prática, porém, câmeras em espaços públicos vêm coletando rostos sem consentimento, sem avisos visíveis, sem políticas de privacidade e sem clareza sobre armazenamento ou compartilhamento de dados. Isso viola princípios como finalidade, necessidade, transparência e responsabilização.

Como alerta Pedro Diogo, os riscos vão além da coleta massiva: “Esses sistemas monitoram todos que circulam, não apenas suspeitos, e ainda operam de forma opaca, tanto nos algoritmos quanto nos contratos firmados com empresas privadas”.

Princípios do INCLO: diretrizes para limitar riscos e orientar políticas

O relatório “De Olho nos Vigilantes”, do INCLO, apresenta 18 princípios fundamentais que visam orientar o uso da TRF de forma responsável ou indicar sua proibição. Segundo o próprio documento, os princípios não endossam o uso da tecnologia pela polícia, mas funcionam como padrões mínimos de responsabilização e mitigação de danos, destacando a necessidade urgente de restrições rigorosas e proibições expressas. Entre eles, estão diretrizes como:

- Proibição do uso de TRF em tempo real (ao vivo);

- Obrigatoriedade de avaliação de impacto sobre direitos fundamentais, independente do fornecedor;

- Consulta pública e divulgação das especificações técnicas antes da implementação;

- Autorização judicial prévia para qualquer operação;

- Documentação e notificação de identificações incorretas;

- Criação de órgãos independentes de supervisão, com relatórios anuais.

Nina da Hora avalia que os princípios oferecem ao Brasil referências práticas para orientar legislações em diferentes níveis, fortalecer a sociedade civil em campanhas, litígios e pressões políticas, e ampliar a supervisão pública com transparência em contratos e auditoria de algoritmos. “O relatório reforça que o uso policial da TRF deve ser banido”, destaca Nina, sublinhando o caráter preventivo da recomendação.

Carla Vreche, acrescenta que os princípios também permitem questionar etapas críticas da implementação da tecnologia, como a construção dos bancos de dados e o treinamento das pessoas que operam os sistemas. “O relatório indica padrões mínimos de responsabilização e mitigação de danos e se torna uma ferramenta importante para campanhas de conscientização e mobilização da sociedade civil”, afirma Vreche.

Engajando o debate sobre reconhecimento facial

Os especialistas ouvidos para esta matéria alertam que a expansão do uso de TRF na segurança pública só pode ser debatida de forma responsável se houver participação ativa da sociedade. Para Vreche é fundamental promover uma reflexão crítica coletiva sobre os riscos dessas ferramentas: “Respostas a questões complexas de segurança pública não podem se basear exclusivamente em soluções tecnológicas”, afirma.

Ela destaca que campanhas de marketing político, como o “prisômetro” em São Paulo, muitas vezes escondem os ciclos de erros na adoção dessas tecnologias que conduzem a potencializar violações.

Thallita Lima complementa que engajar o público exige estratégias que vão além da crítica técnica. É preciso desmistificar a tecnologia, mostrando seu funcionamento real, seus erros e impactos nas desigualdades, e criar espaços de diálogo acessíveis. “Mostramos, por exemplo, em Madureira [no Rio de Janeiro], como a percepção das pessoas muda quando explicamos que as câmeras tendem a errar mais com pessoas negras”, explica Thallita.

Segundo ela, a mobilização deve ocorrer tanto em espaços digitais, como redes sociais, quanto em locais de vivência cotidiana, como escolas, universidades, coletivos comunitários e estádios de futebol, locais que já estão sob intensa vigilância.

Um ponto central, ressalta Thallita, é propor formas coletivas de reimaginar a segurança pública: discutir o que significa segurança, para quem ela se destina e como políticas públicas podem ser construídas de forma participativa e baseada em direitos humanos.