O Oversight Board da Meta divulgou, nesta terça-feira (6), o seu relatório de atividades de 2022, destacando as recomendações feitas à Meta durante o ano, o que foi atendido pela empresa e o que deixou a desejar neste período. O comitê recebeu, neste último ano, 1.3 milhões de pedidos de revisão no mundo, o que equivale a cerca de um quarto a mais que em 2021, e emitiu 91 recomendações para a empresa.

Entre as mudanças positivas destacadas pelo comitê de supervisão está o fato de que a Meta começou a explicar aos usuários qual a política violada em caso de remoção de conteúdo, a informar se a moderação de determinado conteúdo foi feita com revisão humana ou automatizada e a medir a transparência de suas mensagens para os usuários. Além disso, o órgão destacou a criação de uma nova seção nos Padrões da Comunidade sobre desinformação e de um novo protocolo de política de crise.

Algumas das mudanças, informa o relatório, são de recomendações realizadas ainda em 2021 pelo comitê e só implementadas em 2022 pela empresa, como o lançamento de notificações mais específicas aos usuários. “Desde que fizemos essa recomendação pela primeira vez em janeiro de 2021, a Meta vem progredindo gradualmente em direção a esse objetivo. Em resposta a essa recomendação, a Meta introduziu novas mensagens globalmente informando aos usuários a política específica que eles violaram por suas políticas de discurso de ódio, indivíduos e organizações perigosas e intimidação e assédio”, detalhou.

Uma outra recomendação de impacto destacada pelo Oversight Board é sobre a revisão de imagens. O caso específico pedia que a Meta melhorasse a sua detecção automatizada de imagens com sobreposição de texto para garantir que postagens que aumentassem a conscientização sobre sintomas de câncer de mama não fossem sinalizadas erroneamente para revisão como “nudez explícita”. Para o comitê, as melhorias implementadas pela Meta contribuíram significativamente e pelo menos 2.500 peças foram enviadas para revisão humana em vez de serem removidas automaticamente. “Esta é uma vitória para a governança independente e o início de um novo capítulo para a colaboração entre a Meta e o Conselho na compreensão de nosso impacto nos sistemas da Meta”, avaliou o comitê em relatório.

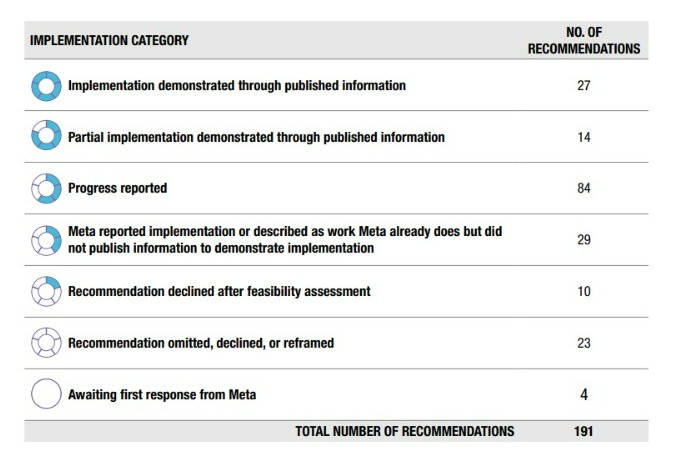

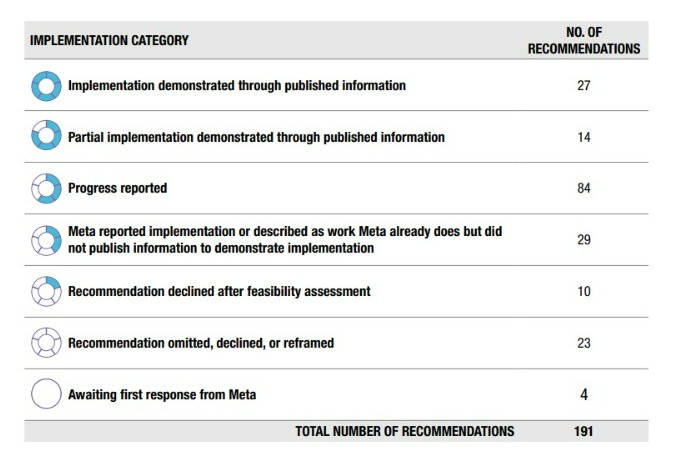

O relatório também abarca recomendações anteriores e faz uma avaliação do cumprimento delas. Das 191 recomendações já dadas à Meta, 27 foram totalmente implementadas, 14 foram implementadas parcialmente e 84 tiveram um progresso reportado ao comitê. Pelo menos 43 recomendações não serão implementadas por decisão da empresa.

O relatório também aponta questões que a Meta precisa se voltar. A primeira delas é a necessidade de alinhar as regras do Facebook e do Instagram, uma medida sugerida ainda em janeiro de 2021. “Embora a empresa inicialmente tenha se comprometido com essa recomendação, ela adiou repetidamente o prazo de implementação. A Meta também ainda não informou aos usuários, conforme nossa recomendação, que a Meta aplica os Padrões da Comunidade do Facebook no Instagram e que, se o conteúdo for considerado infrator no Facebook, também será considerado infrator no Instagram”, relatou o Oversight Board.

O segundo ponto de atenção trazido é a necessidade de que a empresa traduza as orientações internas para os moderadores de conteúdo para os idiomas que eles trabalham, atualmente todas as orientações são em inglês independente do país. Apesar da recomendação, a Meta disse que não realizará nenhuma ação quanto a isso pois “seus moderadores são todos fluentes em inglês”.

O comitê de supervisão também destaca a necessidade da empresa fornecer mais informações sobre os critérios de noticiabilidade, ou seja, o que é considerado na avaliação de determinado conteúdo para que ele se mantenha na rede como de “interesse público” mesmo quando ele fere as regras da plataforma. “A resposta da Meta a essa recomendação pareceu não entender seu propósito, concentrando-se no fato de que algo pode ser escalado para receber o subsídio de noticiabilidade, em vez do que a recomendação pedia: uma descrição de quando e por que algo pode ser escalado. Assim, incentivamos a empresa a priorizar o compartilhamento de mais informações nessa área”, pontua o relatório.

Casos escolhidos

O Oversight Board é um órgão independente que toma decisões de moderação de conteúdo que definem precedentes nas plataformas de mídia social Facebook e Instagram. Essas decisões são tomadas a partir de casos escolhidos pelo conselho. Em 2022, foram submetidos quase 1 milhão e 300 mil casos – ¼ a mais que em 2021 -, mais de dois terços deles correspondiam a conteúdos com incitação à violência ou discursos de ódio. 12% dos casos submetidos eram da América Latina.

Em dois terços dos casos escolhidos para análise pelo Oversight Board, a Meta admitiu que a decisão que tomou em relação ao conteúdo foi errada. Tal reconhecimento também se deu no caso brasileiro em 2023, em que a empresa manteve vídeo antidemocrático na plataforma mesmo após denúncias.

“Nosso objetivo é focar em casos que apresentam questões desafiadoras e consequentes, refletindo uma variedade de regiões geográficas e áreas temáticas. Por meio da seleção de casos que nos permitem examinar as políticas mais importantes para os usuários e da aplicação de uma revisão cuidadosa e baseada em princípios, podemos melhorar as políticas para todos os usuários, e não apenas para aqueles cujos casos são ouvidos”, explicou o comitê sobre a escolha dos casos.